Hace ya varias semanas desde que estalló el movimiento antirracista Black Lives Matter, detonado por el asesinato de George Floyd, pero existe un punto en el que poca gente parece fijarse: la tecnología. No parte de la nada, la creamos nosotros, los humanos. La tecnología también se ve afectada por el racismo estructural de nuestra sociedad, y sus efectos serán paulatinamente peores. Aún así, todavía es posible poner remedio a estas prácticas.

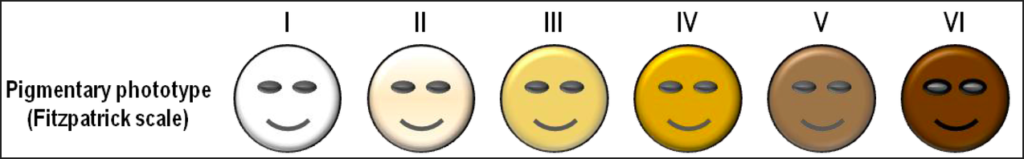

El primero de los casos trata la discriminación en la conducción autónoma: los algoritmos de detección de peatones fallan más con las personas negras, según un estudio de la universidad de Georgia Tech. Los sistemas de conducción autónoma son hasta un 10% menos precisos a la hora de reconocer peatones IV, V y VI (véase la imagen). Es lógico suponer que no se puede culpar a nadie por esto, es un simple algoritmo, pero el problema es que no ha sido entrenado para que sea socialmente justo, y no ponga más en riesgo a determinados colectivos. Lanzar una tecnología al mercado debería cumplir con un decálogo de justicia social. Aunque es de justicia reconocer que estos sistemas de conducción autónoma no funcionan únicamente con cámaras, sino también con escáner LIDAR y mapeo de objetos y personas.

Hace unos años, Google se veía obligado a tomar medidas después de que su algoritmo identificara imágenes de personas negras como gorilas. Otras empresas como IBM y Amazon han incluso abjurado de la tecnología de reconocimiento facial por sus tendencias discriminatorias hacia las personas negras, en especial a las mujeres.

Es cierto que esto no parece ser un problema mayor, pero la Inteligencia Artificial cada vez está en más aspectos de la vida cotidiana. Sin ir más lejos, ya existen cámaras con reconocimiento facial a través de Inteligencia Artificial alertan sobre posibles personas sospechosas. Como advierte un estudio del MIT, la discriminación racial tecnológica desembocará en problemas mayores de identificación: dificultades para pedir un préstamo, alquilar una vivienda o incluso conseguir un puesto de trabajo. Existen herramientas usadas por el Departamento de Defensa de Estados Unidos basadas en algoritmos predictivos, que funcionan para tratar de identificar criminales acorde a información demográfica, así como perfiles sociales. Según la propia institución, es cinco veces más probable que te detengan si eres negro. El problema por el que existe el racismo, es por el hecho de predecir: dar por hecho que determinados grupos raciales están predispuestos a hacer cosas malas.

No vale excusarse en que la tecnología no tiene conciencia para ser racista. Los algoritmos no nacen de la nada, son el fruto de incontables horas de trabajo humano en las que no se hace lo suficiente por lograr un sistema igualitario. Debe activarse la alarma para acabar con el racismo en la tecnología, de lo contrario, más adelante puede ser demasiado tarde. Si los algoritmos se entrenaran con datos no sesgados, no estaríamos ante un problema de dimensiones tan grandes. Un mayor esfuerzo, por parte de los gigantes tecnológicos, sería un paso en la dirección correcta del camino a una tecnología responsable que no deje a nadie atrás.

Comentarios